Acaban de salir dos modelos que, al menos sobre el papel, pintan como los nuevos pesos pesados para crear software con IA: GPT 5.5 y Claude Opus 4.7. Y cuando aparecen modelos así, siempre pasa lo mismo: salen benchmarks, tablas, rankings, comparativas técnicas y un montón de números.

El problema es que una cosa es leer benchmarks y otra muy distinta es sentarse a trabajar con ellos.

Porque en la práctica, lo que importa no es solo quién saca mejor puntaje en un paper. Importa qué tan bien sigue instrucciones, qué tan rápido responde, qué tan usable queda lo que genera y si realmente te ahorra tiempo al construir una app.

Así que en vez de quedarme con la teoría, hice una comparación directa creando 4 aplicaciones con el mismo prompt en ambos modelos. El entorno fue el mismo, la herramienta fue la misma y los prompts fueron los mismos. Cambié únicamente el modelo.

Las pruebas fueron estas:

- Un dashboard moderno con Next.js, Tailwind CSS y shadcn/ui

- Una simulación 3D de trenes en el navegador

- Un juego tipo Galaga con efectos visuales y lógica básica

- Una app Kanban estilo Trello para gestión de tareas

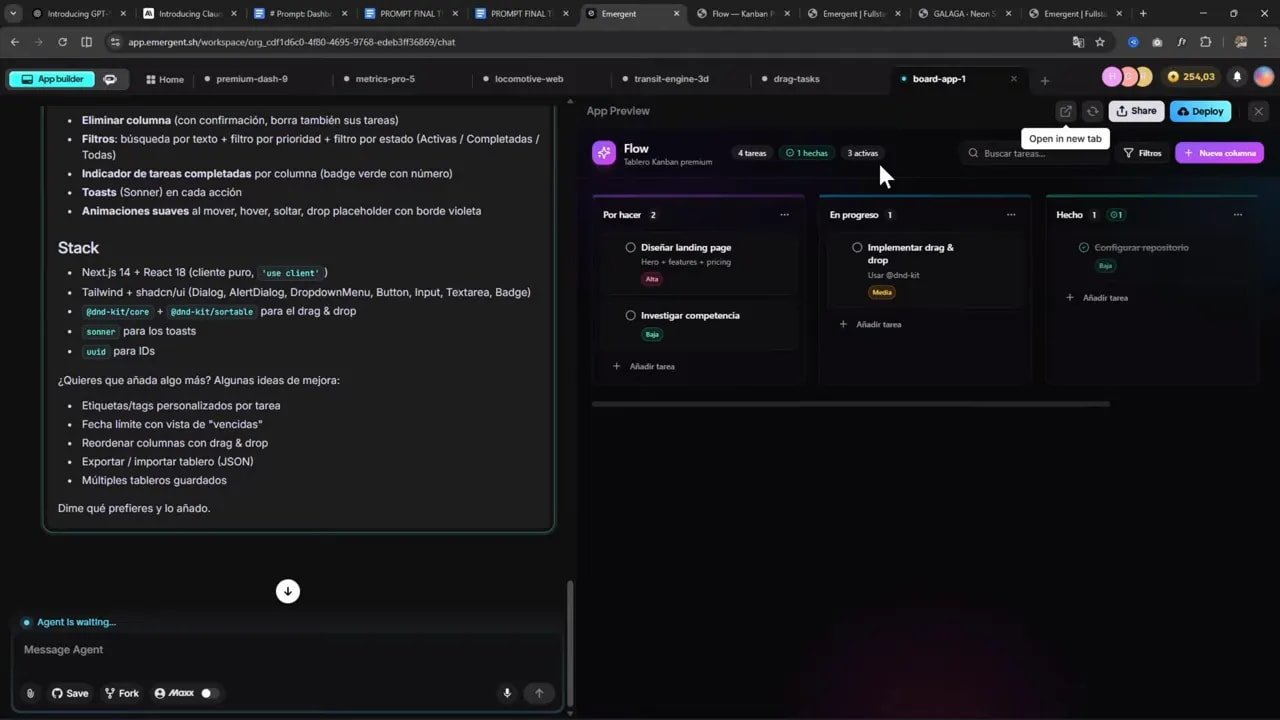

Todo esto lo hice usando Emergent, una herramienta que me gusta bastante porque permite trabajar con varios modelos en paralelo dentro del mismo entorno. Eso hace que la comparación sea mucho más limpia y mucho más útil.

Si quieres revisar las herramientas y recursos mencionados, aquí están los enlaces:

Tabla de contenido

- ⚙️ Cómo hice la comparación para que fuera justa

- 📊 Prueba 1: dashboard moderno con Next.js, Tailwind y shadcn

- 🚂 Prueba 2: simulación 3D de trenes en el navegador

- 👾 Prueba 3: juego tipo Galaga con glow y creatividad

- 🗂️ Prueba 4: app Kanban estilo Trello

- ⏱️ Velocidad, consistencia y experiencia real al construir

- 🧠 Qué modelo se vio mejor en cada tipo de tarea

- 💸 El detalle que nadie debería ignorar: el costo

- 🔗 Herramientas y recursos para repetir esta comparación

- 🏁 Veredicto final: ¿cuál gana?

- 🛠️ La conclusión realmente útil

⚙️ Cómo hice la comparación para que fuera justa

La base de esta comparativa fue simple: mismo prompt, mismo entorno, distinto modelo.

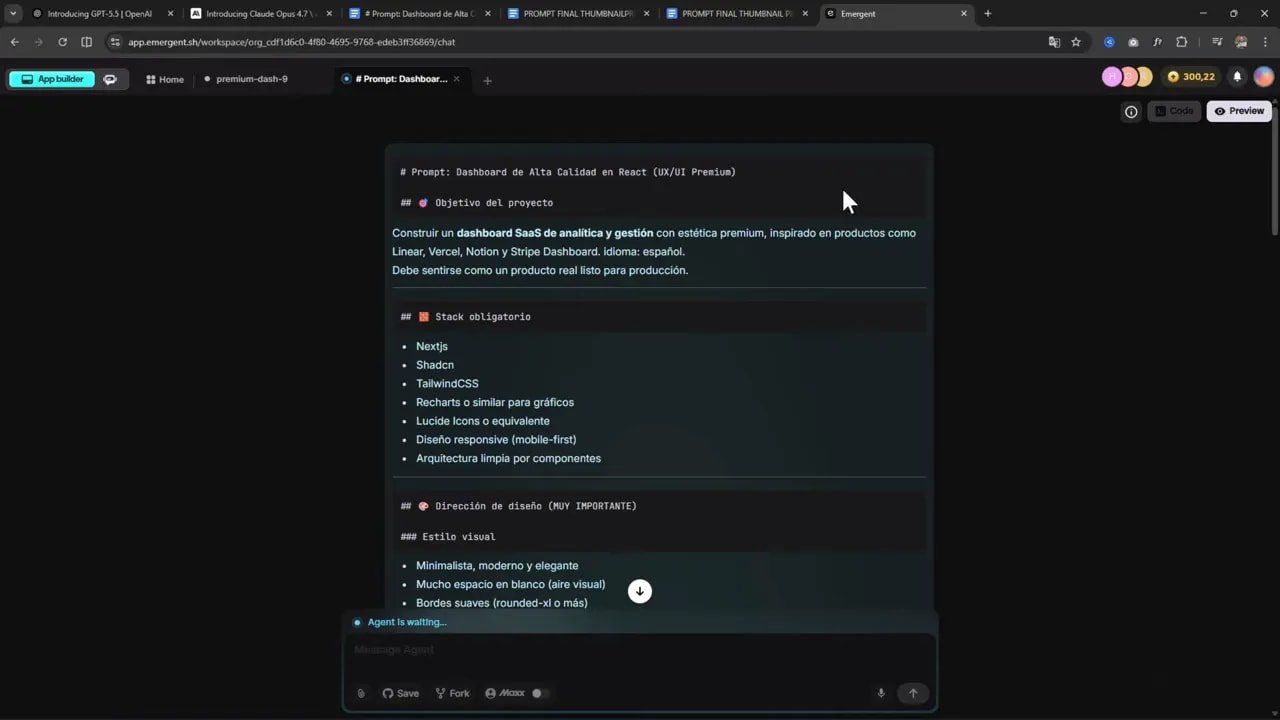

Usé Emergent porque tiene algo muy cómodo para este tipo de pruebas. Puedes abrir proyectos en paralelo, pegar exactamente la misma instrucción y dejar que cada modelo trabaje por su cuenta. No todas las herramientas te dejan hacer eso con tanta facilidad.

Ese detalle importa más de lo que parece.

Si comparas modelos en herramientas distintas, ya no sabes si la diferencia se debe al modelo o al producto que lo envuelve. En cambio, acá el terreno estaba bastante nivelado. Eso me permitió fijarme en cosas mucho más concretas:

- Velocidad de ejecución

- Calidad visual del resultado

- Capacidad de seguir instrucciones

- Consistencia general

- Funcionalidad real de lo generado

Y algo importante: no busqué prompts imposibles ni casos ultra rebuscados. Las pruebas están bastante alineadas con cosas que realmente alguien construiría hoy usando IA para desarrollar apps web.

Ese enfoque también me parece más honesto. Muchas veces se fuerzan pruebas demasiado académicas y luego, en el día a día, la experiencia real es otra. Aquí la idea fue medir justo eso: cómo se sienten estos modelos cuando les pides construir algo útil.

📊 Prueba 1: dashboard moderno con Next.js, Tailwind y shadcn

La primera prueba fue un caso bastante estándar: generar un dashboard usando Next.js, Tailwind CSS y shadcn/ui.

No era un prompt exótico ni una solicitud fuera de lo común. Precisamente por eso me gustó para empezar. Un dashboard así es una tarea muy representativa del tipo de trabajo que muchos hacen con IA: paneles internos, admin panels, dashboards SaaS, analytics simples, etc.

Además, el prompt incluía una línea estética importante: el diseño debía ser minimalista, no muy recargado.

Eso servía para evaluar algo más interesante que “si funciona o no funciona”. Servía para ver si el modelo realmente captaba la intención del pedido.

Lo que hizo Claude Opus 4.7

Opus avanzó más rápido al comienzo. De hecho, fue el primero en terminar esta tarea. La propuesta visual no era impresionante en el sentido de “wow, esto parece hecho por un estudio de diseño”, pero sí tenía algo valioso: consistencia.

El dashboard se veía claro, simple y alineado con la idea de minimalismo. Incluía datos demo, un usuario autenticado simulado y una estructura bastante ordenada.

Hubo un detalle que al principio parecía un fallo: el resultado se veía en modo claro cuando la intención era más bien oscura. Pero en realidad el modo oscuro sí estaba implementado. Solo que estaba accesible al hacer clic para cambiar el tema.

Eso ya deja una lectura interesante. Opus siguió la instrucción, pero no necesariamente la presentó de la forma más directa posible.

Lo que hizo GPT 5.5

GPT 5.5 también resolvió el dashboard sin dificultad. Y aquí pasó algo interesante: aunque no suele asociarse primero con frontend cuando uno piensa en fortalezas de modelo, cumplió muy bien.

La interfaz se veía sólida y tenía detalles agradables, como cierta animación en un gráfico. Todo lo importante estaba ahí. No hubo problemas de ejecución ni fallos llamativos en la experiencia general.

Mi impresión aquí fue que no hubo una diferencia brutal de nivel. Más bien había dos estilos distintos.

- Opus 4.7 entregó una propuesta sobria, consistente y limpia

- GPT 5.5 entregó una propuesta también funcional, visualmente agradable y con un poco más de personalidad en algunos detalles

En otras palabras, en esta primera prueba no sentí que uno aplastara al otro. Si alguien eligiera uno u otro solo por este caso, probablemente dependería más de su gusto visual que de una diferencia objetiva enorme.

Qué enseña esta primera prueba

Para tareas de interfaz relativamente estándar, ambos modelos ya juegan en una liga muy alta.

Si tu trabajo consiste en prototipar dashboards, paneles administrativos o interfaces modernas con un stack común de frontend, la verdad es que los dos son totalmente utilizables.

La diferencia acá no fue “uno sirve y el otro no”. La diferencia fue más fina:

- cómo interpretan el tono visual del prompt

- cómo distribuyen los componentes

- qué tan bien equilibran simpleza y atractivo

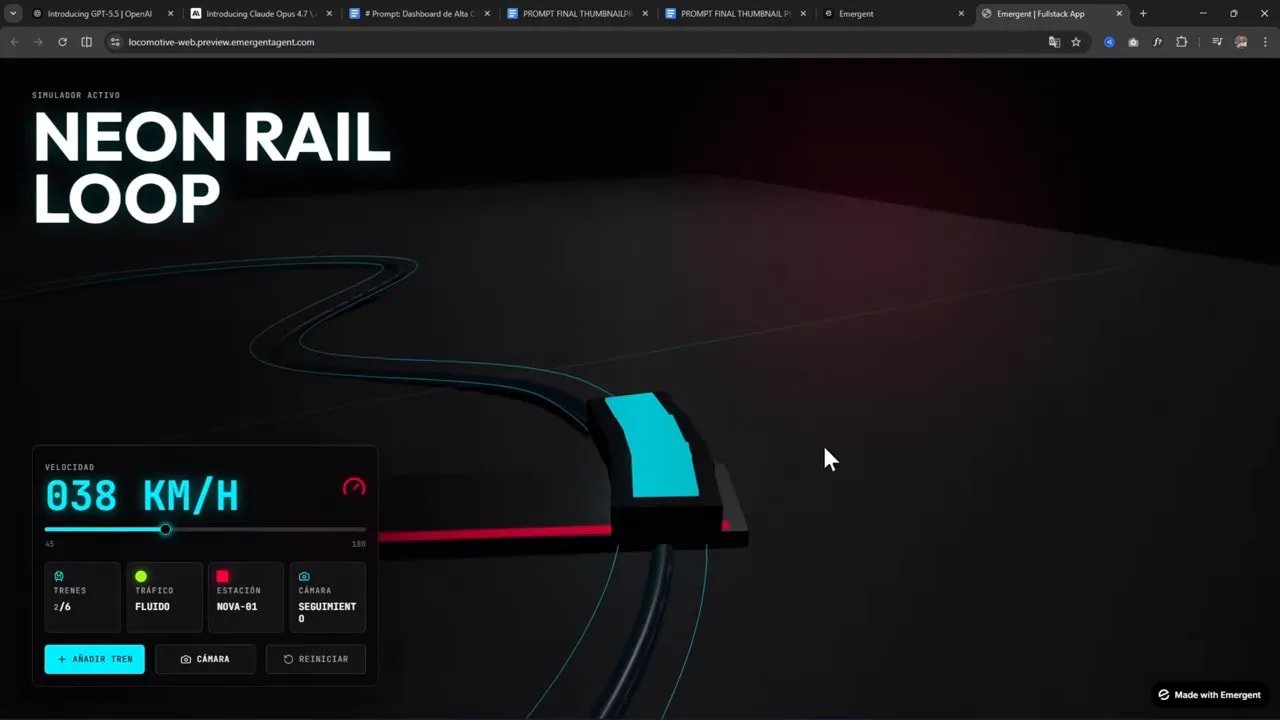

🚂 Prueba 2: simulación 3D de trenes en el navegador

Acá la cosa se puso mucho más interesante.

La segunda prueba consistió en pedir una simulación web 3D de trenes, simple pero visualmente atractiva, funcionando directamente en el navegador. Este tipo de prompt ya no prueba solo UI. También prueba coordinación de lógica, visualización, interacción y cierta noción espacial.

Y antes de correrla, ya tenía una sospecha: por lo que había investigado, GPT 5.5 parecía especialmente fuerte en este tipo de tareas.

La pregunta era si eso se iba a notar de verdad o si quedaría solo como teoría.

El resultado de GPT 5.5

GPT 5.5 terminó primero. Y apenas revisé el resultado, se entendió por qué tanta gente estaba hablando bien de este modelo para simulaciones.

La app incluía:

- control de velocidad

- opciones de cámara

- cámara de seguimiento

- vista orbital

- capacidad de agregar otro tren

Eso no es menor. No era simplemente una escena bonita con un tren moviéndose. Había una estructura interactiva clara, controles útiles y una sensación de sistema funcionando de forma coherente.

Este fue uno de esos casos en que la diferencia no quedó en el código ni en una métrica. Se sintió directamente en el resultado. GPT 5.5 no solo resolvió la tarea. La resolvió con soltura.

El resultado de Claude Opus 4.7

Opus, en cambio, mostró señales de problemas durante la generación. En las capturas previas ya se veía que algo no iba del todo bien, con pantallas blancas mientras trabajaba.

Cuando finalmente estuvo listo, el contraste fue evidente.

No logró lo que yo esperaba visualmente. Tomó algunos colores del prompt, sí, pero la implementación no tenía la misma claridad ni la misma calidad. Tampoco se distinguía bien esa estética oscura que se buscaba. Y, sobre todo, el nivel general estaba claramente por debajo del resultado de GPT 5.5.

Acá sí hubo un ganador claro. No uno “ligeramente mejor”. Uno notoriamente superior.

Por qué esta prueba es importante

Muchas personas usan IA para generar interfaces, landing pages o CRUDs. Pero cuando empiezas a pedir cosas con más interacción, con escena 3D, con comportamiento dinámico o con pequeños sistemas visuales, el modelo tiene que demostrar otra clase de capacidad.

Y en esta prueba, GPT 5.5 dejó una señal bastante fuerte: parece muy competente para experiencias interactivas más complejas.

Si tu foco es crear demos, simulaciones, prototipos visuales o experiencias que dependan mucho del navegador y la interacción, yo pondría especial atención a este resultado.

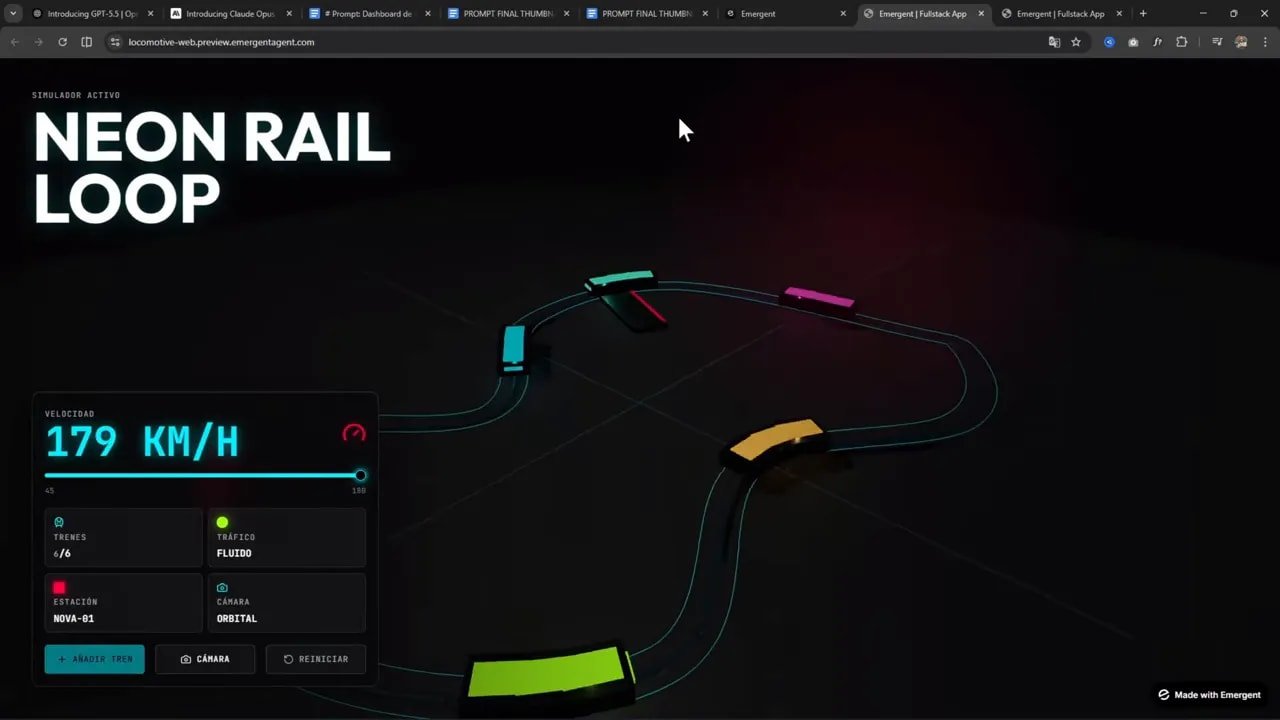

👾 Prueba 3: juego tipo Galaga con glow y creatividad

La tercera prueba fue pedir algo más lúdico: crear un juego estilo Galaga, con efectos glow y libertad creativa para que no fuera “lo más básico de lo básico”.

Me gustó esta prueba porque obliga al modelo a combinar varias cosas al mismo tiempo:

- interfaz

- lógica de gameplay

- feedback visual

- respuesta a inputs

- cierto criterio estético arcade

Además, la palabra “sé creativo” siempre es un test interesante. Algunos modelos se apegan demasiado a lo mínimo funcional. Otros se arriesgan un poco más.

Velocidad y primera impresión

GPT 5.5 volvió a moverse muy rápido. Mientras Opus todavía no mostraba demasiado en pantalla, GPT ya tenía algo listo para revisar.

Ese detalle de velocidad no es decorativo. Cuando estás iterando con IA, la rapidez cambia completamente el flujo de trabajo. Un modelo apenas mejor, pero mucho más lento, a veces termina siendo menos útil en el día a día.

Lo que entregó GPT 5.5

La propuesta de GPT 5.5 dio una experiencia de arcade reconocible. Había acción inmediata, ataques enemigos y elementos visuales que hacían que el resultado se sintiera más “juego” y menos “demo técnica”.

Incluso aparecía el clásico guiño de Insert Coin, que le sumaba personalidad.

Lo que más me llamó la atención aquí fue que se veía mejor de lo esperado. No era simplemente correcto. Tenía presencia visual. Y esa es una diferencia muy importante cuando le pides a un modelo que no solo construya algo funcional, sino que tenga una cierta gracia.

¿Y Opus 4.7?

En esta sección no hubo tanto detalle comparativo fino como en otras, pero la impresión general fue que GPT 5.5 seguía mostrando una mejor combinación entre rapidez, ejecución y atractivo visual.

Eso no significa que Opus no pueda generar juegos o experiencias interactivas. Significa que en esta prueba concreta, con este tipo de prompt, GPT 5.5 dejó una sensación más sólida.

Qué revela esta prueba sobre ambos modelos

Los juegos simples son engañosos. Parecen una prueba liviana, pero en realidad exigen muchas microdecisiones correctas:

- cómo se mueve el personaje

- cómo responden los enemigos

- qué tan clara es la interfaz

- si el feedback visual acompaña la acción

- si la experiencia tiene ritmo

Cuando un modelo resuelve eso bien, suele ser señal de que no solo “genera código”, sino que integra varias capas del problema con bastante criterio.

Y nuevamente, GPT 5.5 salió bien parado.

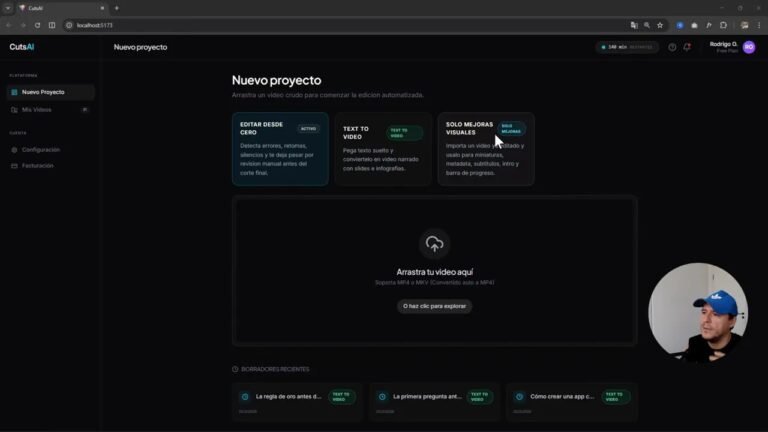

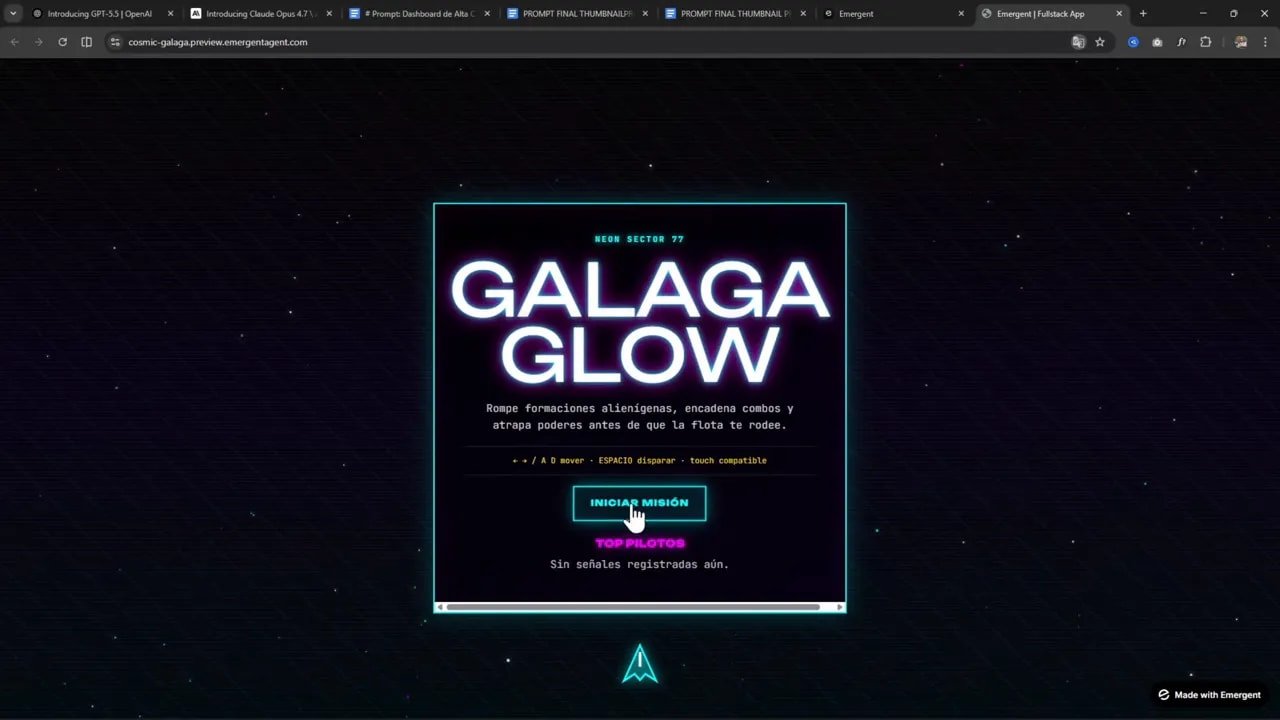

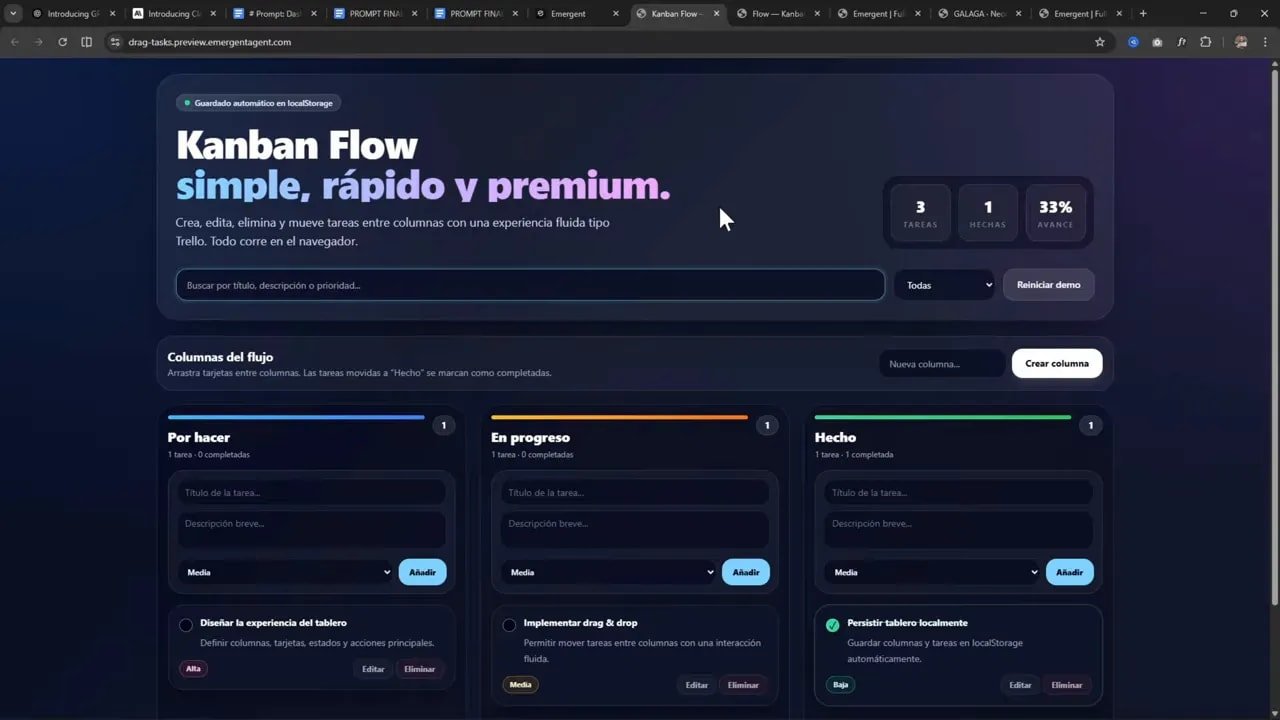

🗂️ Prueba 4: app Kanban estilo Trello

La cuarta prueba fue mucho más cercana a una necesidad real de producto: una aplicación Kanban tipo Trello para gestión de tareas.

Este tipo de app es excelente para comparar modelos porque mezcla:

- estructura de datos

- componentes repetibles

- estado de interfaz

- drag and drop o al menos movimiento entre columnas

- filtros, columnas y organización visual

Es decir, no basta con que “se vea linda”. Tiene que funcionar.

El resultado de Claude Opus 4.7

En esta ocasión, Opus terminó un poquito antes. La aplicación permitía mover tareas entre estados, añadir columnas y usar filtros. Había una funcionalidad básica real, y eso ya la hacía válida como resultado.

La sensación general fue: simple, pero funciona.

Y eso, en una app de productividad, ya cuenta bastante. Porque si una interfaz es preciosa pero el flujo principal falla, sirve de poco.

El resultado de GPT 5.5

GPT 5.5 presentó otro enfoque visual. Acá sí se notó que invirtió un poco más en diseño. El tablero se veía más trabajado y más cuidado desde la parte estética.

En funcionalidad también respondió bien. Se podían mover tarjetas y la base del sistema estaba resuelta. No aparecieron fallos importantes.

Mi lectura aquí fue bastante clara:

- Funcionalmente, ambos estuvieron bien

- Visualmente, GPT 5.5 hizo un mejor trabajo

Otra vez, no por una diferencia abismal en lo básico, sino por una diferencia en el refinamiento final.

Lo que aporta esta prueba al veredicto general

La prueba Kanban sirve como contrapeso frente a las simulaciones y el juego. Porque no todo el mundo necesita una escena 3D o un arcade espacial. Muchísima gente necesita herramientas internas, paneles, tableros de tareas y sistemas CRUD con una capa de UX agradable.

Y aquí ambos modelos demostraron que pueden ser útiles para construir ese tipo de producto.

La diferencia estuvo más en el acabado que en la capacidad de llegar a una solución funcional.

⏱️ Velocidad, consistencia y experiencia real al construir

Más allá de cada app individual, hubo tres factores que me parecieron claves en esta comparación: velocidad, consistencia y comportamiento práctico.

1. Velocidad

En varias pruebas, GPT 5.5 se sintió más rápido. No siempre por una diferencia gigantesca, pero sí lo suficiente como para notarlo.

Y eso importa muchísimo cuando trabajas iterativamente.

Construir con IA no es pedir una sola vez y listo. Normalmente haces esto:

- pides una versión inicial

- corriges detalles

- ajustas diseño

- agregas funciones

- refactorizas algo que quedó raro

Si el modelo responde rápido, el ciclo entero mejora. Y si además responde bien, mejora todavía más.

2. Consistencia

Opus 4.7 mostró buena consistencia en tareas más de interfaz y estructura visual limpia. Donde el objetivo era entregar algo ordenado, sin estridencias y razonablemente bien alineado con el prompt, respondió bien.

GPT 5.5, por su parte, se mostró más fuerte cuando la prueba exigía más interacción, más complejidad visual o más dinamismo.

3. Experiencia real

Esta es probablemente la conclusión más importante de todas: los benchmarks no te cuentan toda la historia.

Puede haber modelos que rankean excelente en tablas comparativas, pero cuando les pides una app concreta dentro de tu flujo de trabajo, la experiencia no siempre coincide con el ranking. A veces la diferencia es mínima. A veces es enorme. Y a veces depende completamente del tipo de tarea.

Por eso prefiero mucho más este enfoque de pedir cosas reales y comparar resultados reales.

🧠 Qué modelo se vio mejor en cada tipo de tarea

Si tuviera que resumir la comparación por categorías, lo dejaría así:

- Dashboard moderno: empate técnico con estilos distintos

- Simulación 3D de trenes: ventaja clara para GPT 5.5

- Juego tipo Galaga: ventaja para GPT 5.5

- App Kanban: ambos funcionales, GPT 5.5 mejor en diseño

Si lo traduzco a una lectura más práctica:

Cuando Claude Opus 4.7 se siente fuerte

- interfaces limpias y sobrias

- estructuras claras

- resultados consistentes

- apps donde lo funcional pesa más que el lucimiento visual

Cuando GPT 5.5 se siente especialmente fuerte

- simulaciones interactivas

- experiencias con más lógica visual

- proyectos creativos

- resultados donde el acabado visual y el dinamismo importan mucho

Obviamente, esto no significa que uno solo sirva para una cosa y el otro para otra. Ambos son modelos top. Pero sí deja la impresión de que GPT 5.5 tiene una ventaja práctica bastante visible en tareas más complejas o más “vivas” en el navegador.

💸 El detalle que nadie debería ignorar: el costo

Hay un comentario muy realista que no conviene pasar por alto: estos modelos no son baratos.

Y cuando haces varias generaciones, pruebas paralelas, iteraciones y experimentos, los créditos se van rápido.

Eso hace que comparar bien antes de comprometerte con un modelo tenga todavía más sentido. Si vas a invertir dinero en un flujo de trabajo con IA, no basta con saber cuál es el “mejor” en abstracto. Necesitas saber cuál te da más valor para el tipo de aplicaciones que tú construyes.

Por ejemplo:

- Si tu día a día son dashboards, paneles internos y apps de negocio, quizá ambos te sirvan bastante

- Si haces demos técnicas, experiencias interactivas o prototipos más visuales, GPT 5.5 parece ofrecer una ventaja más clara

El retorno no está solo en la calidad. También está en cuánto tardas en llegar a un resultado útil.

🔗 Herramientas y recursos para repetir esta comparación

Si quieres hacer tus propias pruebas, estos son los enlaces útiles:

- Emergent, la herramienta usada para ejecutar múltiples modelos en paralelo: https://get.emergent.sh/ppipwlv6az20

- Comunidad en Skool, donde comparto herramientas, prompts y recursos para crear apps con IA: https://www.skool.com/vibe-coding-crea-apps-con-ia-5930

- Playlist de apps web con IA para seguir profundizando: https://www.youtube.com/playlist?list=PLBTuX25MUpdo9YuMzu-o9c80p1q40EBfI

Mi recomendación si vas a probar por tu cuenta es que uses prompts que realmente se parezcan a tu trabajo. No compares con ejercicios genéricos si luego tú construyes otra clase de producto. Cuanto más real sea el caso de prueba, más útil será la conclusión.

🏁 Veredicto final: ¿cuál gana?

Si me obligaran a elegir un ganador general en esta comparativa concreta, diría que GPT 5.5 sale adelante.

No porque haya ganado absolutamente todo, sino porque:

- fue muy sólido en frontend

- fue claramente mejor en la simulación 3D

- se vio mejor en la prueba del juego

- en Kanban mantuvo la funcionalidad y además aportó mejor diseño

Claude Opus 4.7, de todos modos, no quedó mal parado. Para nada. En el dashboard respondió bien, en la app Kanban fue funcional y en general mostró buena consistencia. Sigue estando entre los mejores modelos disponibles.

Pero si lo que buscas es una herramienta que te sorprenda en tareas más exigentes, con más movimiento, más interactividad y más impacto visual, GPT 5.5 dejó una impresión más fuerte.

Y esa, al final, es la clase de diferencia que sí se nota cuando estás construyendo.

🛠️ La conclusión realmente útil

La mejor lección de toda esta comparación no es simplemente “usa este modelo y no el otro”. La lección es otra:

Prueba los modelos en escenarios reales de tu flujo de trabajo.

No te quedes solo con benchmarks. No te quedes solo con rankings. No te quedes solo con lo que dice todo el mundo en X o en Reddit. Ponlos a trabajar con el tipo de app que tú quieres construir.

Ahí es donde aparecen las diferencias que de verdad importan:

- si entiende bien la intención

- si entrega rápido

- si el resultado ya sale usable

- si evita errores tontos

- si te da ganas de seguir iterando en vez de pelear con la herramienta

Y al menos en este conjunto de pruebas, la sensación fue bastante clara: GPT 5.5 y Claude Opus 4.7 son el top 1 y 2 del momento, pero GPT 5.5 mostró una ventaja más práctica en varios escenarios clave.

Si estás creando apps web con IA, vale la pena tener ambos en el radar. Pero si tuviera que apostar por uno para experimentar ahora mismo con cosas más ambiciosas, interactivas y visuales, empezaría por GPT 5.5.

Y luego, como siempre, lo mejor es dejar que el código hable.