Estoy construyendo una app propia que hace algo que suena simple, pero en la práctica es un montón de piezas moviéndose a la vez: crear y editar videos de estilo YouTube con IA, desde texto o a partir de material existente, con voz clonada, subtítulos, detección de cortes y hasta generación de miniaturas y kit de publicación.

Este es el primer episodio de un proyecto que venía trabajando en paralelo, y el punto clave que me importa compartir es este: no se trata solo de “usar un modelo”. Se trata de orquestar un flujo que sea útil para publicar más rápido, con control humano donde corresponde y con una mentalidad nueva: pasar menos tiempo puliendo el formato y más tiempo creando valor.

En este artículo te cuento la arquitectura mental y las funcionalidades principales del sistema, qué integraciones uso y los aprendizajes que salieron a la luz mientras lo probaba. Si quieres replicar la idea, aunque no uses exactamente las mismas herramientas, te vas a llevar un mapa bastante claro de cómo pensar este tipo de app.

Tabla de contenido

- 🧠 La idea central: no más “perfección”, más publicación con control

- 🛠️ Qué construí: una app que crea y edita videos de YouTube con IA

- ⚡ Por qué hago mayormente Shorts (y cómo eso afecta el diseño del sistema)

- 🎬 Edición automática: detección de retomas, silencios y cortes con modo visión

- 🔁 Human in the Strict Loop: revisar frase por frase antes de generar el resultado final

- 📌 El kit de publicación: títulos, descripción y miniaturas generadas con base en transcripción

- 🧠 Voz clonada y generación desde texto: flujos con Gemini, Qwen TTS y modelos de audio

- 🧱 Arquitectura por dentro: front-end, back-end y orquestación

- 🖼️ Miniaturas con IA: de screenshots a propuestas conceptuales

- 📍 Persistencia: títulos, descripciones y miniaturas no deberían “desaparecer”

- 🎯 Miniatura como conjunto: enlace entre título, descripción y imagen

- 🧩 Ojo con los prompts rígidos: contexto dinámico por tipo de video

- 📱 Lo que más importa para escalar: eficiencia, costos y control

- 🔗 Links importantes (comunidad y recursos)

- 📌 Qué haría después (y por qué): mejoras de persistencia, thumbnails inteligentes y robustez

- ✅ Ideas aplicables si estás construyendo tu propia app de video con IA

- 🚀 Conclusión: IA para producir contenido, pero con un sistema que respete el criterio humano

🧠 La idea central: no más “perfección”, más publicación con control

Uno de los cambios más importantes que estoy haciendo no es técnico, es de filosofía. Durante mucho tiempo el flujo de producción de contenido (títulos, descripción, miniaturas, edición fina) se sentía como un freno: siempre existe algo que mejorar y terminabas atrasándote.

Lo que busco con esta herramienta es adelantar trabajo. Que el sistema proponga y yo corrija. Que el “borrador” exista rápido. Que el contenido esté listo para publicar con iteraciones cortas, en vez de quedarte atrapado en el ciclo de pulir hasta que sea perfecto.

Por eso el flujo tiene un componente fuerte de “Human in the loop”. Puede automatizar, pero yo tengo momentos de revisión. Y cuando una sugerencia falla, no significa que el proyecto sea inútil. Significa que hay un lugar específico donde ajustar prompts, persistencia del estado o integraciones.

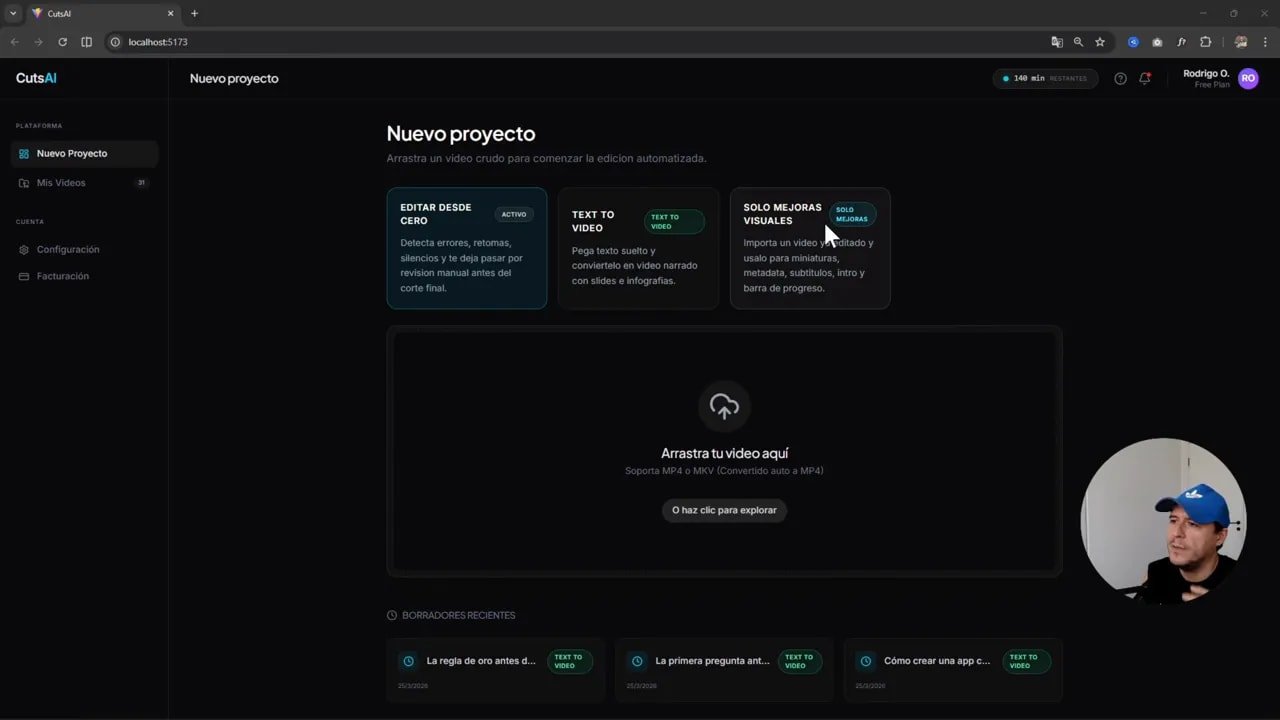

🛠️ Qué construí: una app que crea y edita videos de YouTube con IA

La app que estoy desarrollando tiene dos grandes caminos:

- Edición automática de videos existentes, con cortes, detección de silencios y retomas, y transcripción precisa.

- Creación desde texto, generando un video “faceless” con voz y elementos visuales, usando clonación de voz y modelos de generación de imágenes.

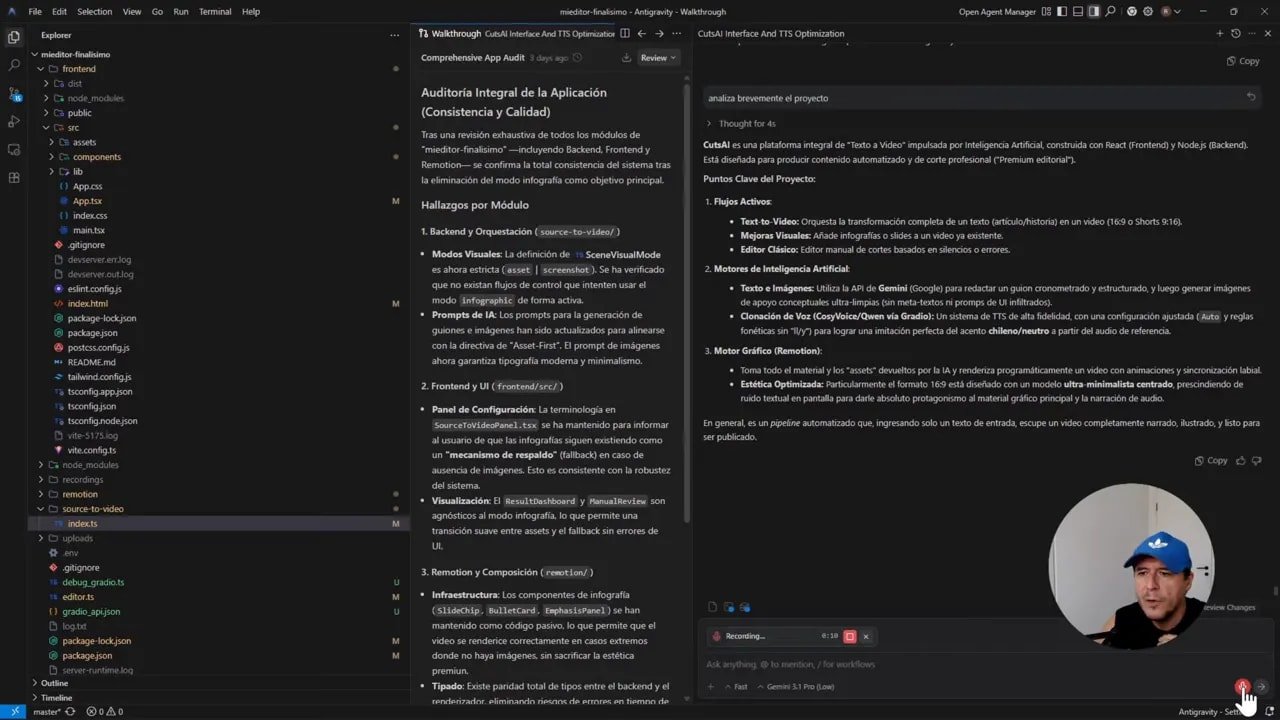

Todo esto lo estoy orquestando sobre Google Antigravity, y el backend que termina existiendo (con lógica y pipelines) es lo que permite que el sistema se sienta como una sola herramienta, no como un conjunto de servicios desconectados.

⚡ Por qué hago mayormente Shorts (y cómo eso afecta el diseño del sistema)

En el proyecto estoy haciendo mayormente shorts porque son más económicos de producir “bien”. Y cuando uno construye una app, el costo de iteración importa muchísimo: renderizar, generar imágenes, transcribir, rehacer miniaturas. Todo suma.

Pero incluso en shorts aparece un problema real: los modelos y los flujos son lo suficientemente costosos como para que necesites que cada paso sea eficiente. Si el sistema se demora demasiado o falla en partes críticas, tu producto no escala.

Por eso la edición automática y el modo de “procesar rápido” para detectar cortes se vuelve parte del corazón del producto.

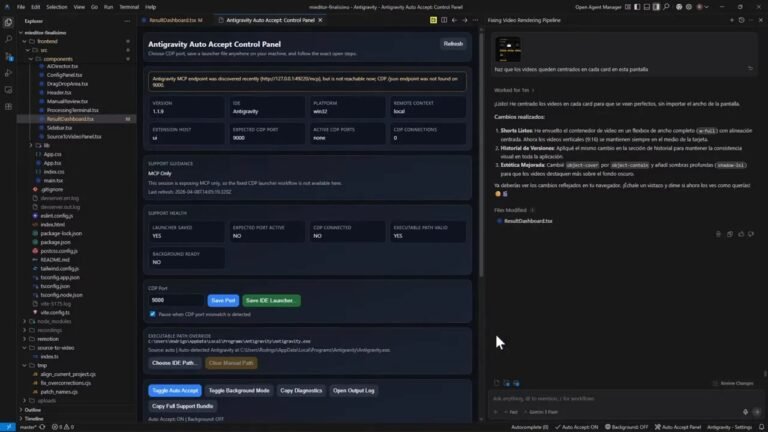

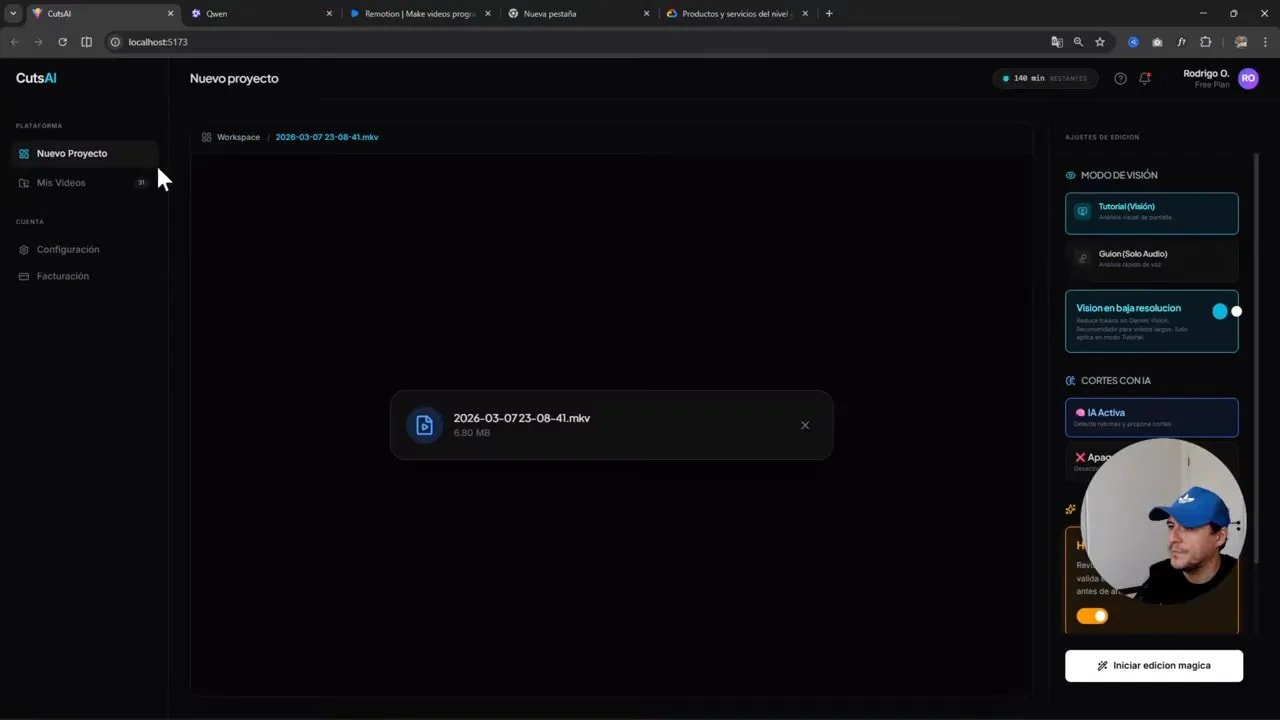

🎬 Edición automática: detección de retomas, silencios y cortes con modo visión

La parte de edición automática es donde se nota más el valor de una buena orquestación. Yo necesito que el sistema:

- Entienda el video y sugiera dónde cortar

- Sea preciso con la transcripción (para que los cortes caigan en el lugar correcto)

- Permita “fallar con elegancia”: que si propone un corte mal, pueda revertirse

La app trabaja con dos modos importantes:

👁️ Modo visión (video + audio)

Este modo mira el contenido, escucha el audio y utiliza esa información para proponer cortes con más contexto. Es perfecto para videos cortos porque mantiene el proceso liviano. En el proyecto, incluso se destaca que un ejemplo alrededor de 2 minutos y algo funciona bien, y que el modo visión ayuda porque el sistema puede “entender” la estructura.

🎧 Modo solo audio (para videos largos)

Cuando el video es muy largo, el modo visión se puede volver ineficiente o directamente inviable para ciertos tamaños. Entonces entra una estrategia: transcribir con Whisper y usar esa transcripción para cortar.

Whisper es útil porque da una transcripción muy precisa con tiempos exactos de palabras. Para edición, eso es oro.

Además, si estás lidiando con videos de horas, ahí aparece otra práctica: procesar el video en baja resolución para acelerar la detección de cortes. No es un “hack” mágico, es una configuración que aprovecha que, para detectar cortes, no necesitas máxima resolución.

🧩 Silencios y reglas de edición

También puedes parametrizar reglas como:

- Cuánto silencio máximo tolerar

- Qué tan agresivo es el recorte para entrar a TikTok (en el proyecto se menciona un ajuste pensado para eso)

- Preferencias para normalizar audio

La idea es que la edición no sea genérica. Sea “de producción”, adaptada a la plataforma y al estilo de contenido que haces.

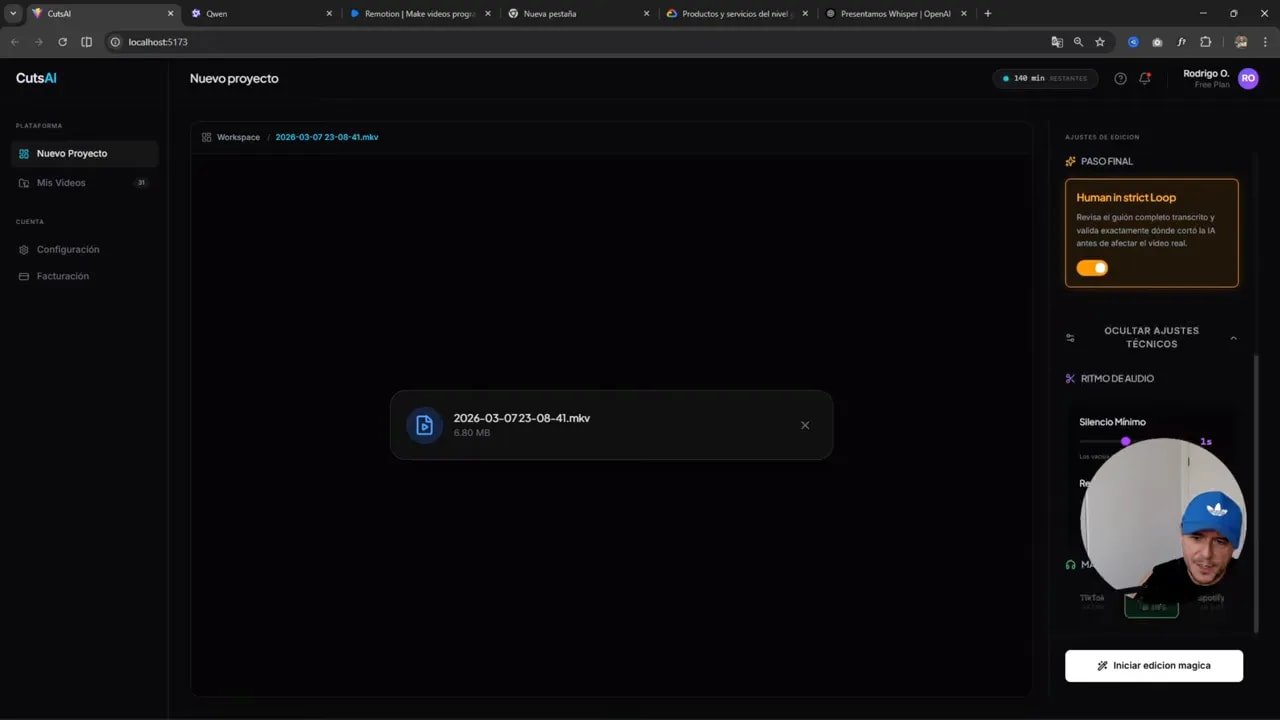

🔁 Human in the Strict Loop: revisar frase por frase antes de generar el resultado final

Uno de los puntos más importantes es cómo evitas que la edición automática destruya el sentido del video.

En el proyecto existe un modo tipo “Human in the Strict Loop”. Cuando está habilitado, el sistema no te deja completamente a ciegas. En vez de generar todo el video final automáticamente, te permite revisar segmentos con más control.

Y algo clave: se generan “propuestas” de cortes que pueden ser errores. Por eso el sistema trae acciones para corregir como “restaurar” (no cortar), en vez de obligarte a reiniciar todo el proceso.

Ese detalle hace que la herramienta sea usable en la vida real: tus iteraciones deben ser rápidas incluso cuando algo sale mal.

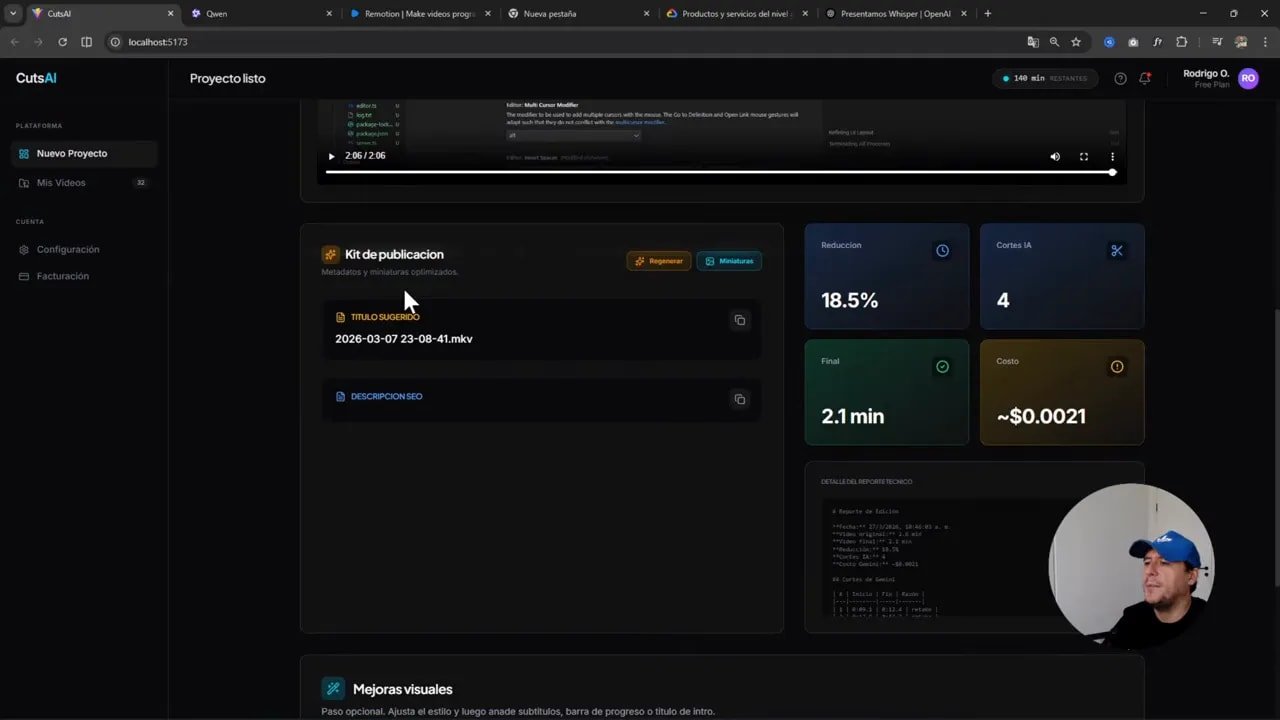

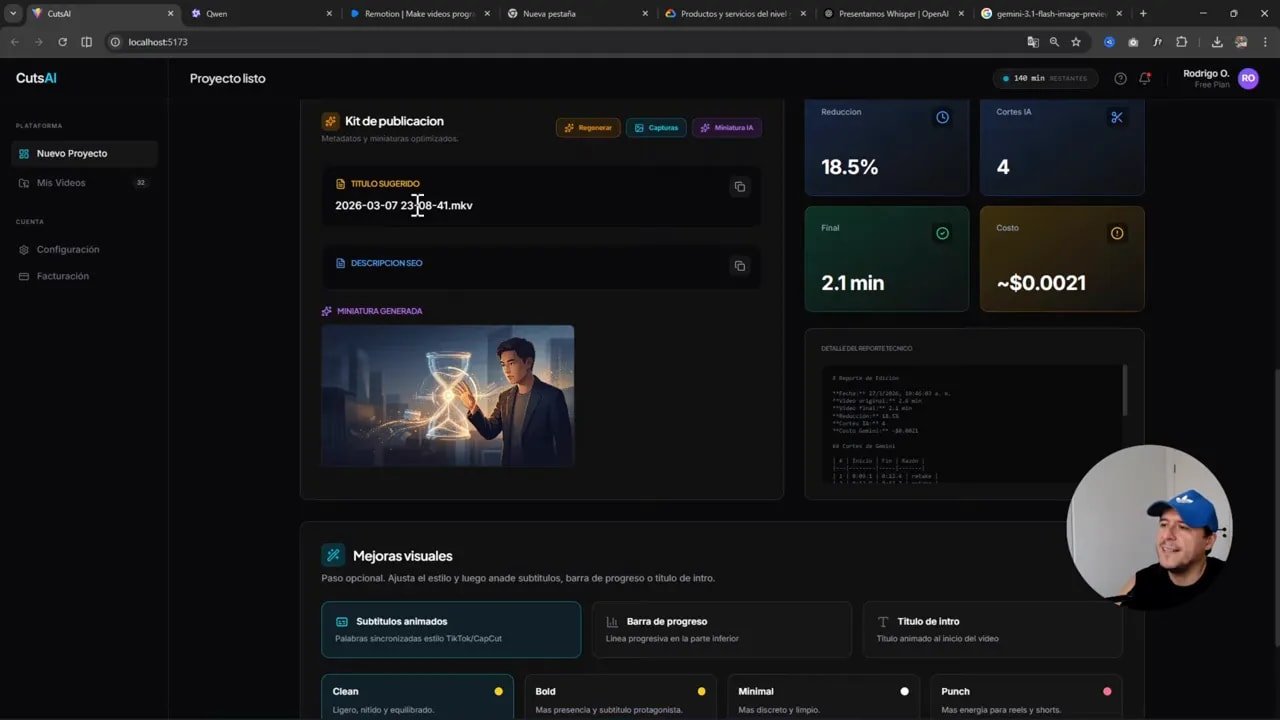

📌 El kit de publicación: títulos, descripción y miniaturas generadas con base en transcripción

Una de las partes más prácticas que quiero destacar es el kit de publicación. Una vez que el sistema tiene transcripción (y entendió el contenido), puede generar:

- Título

- Descripción

- Miniaturas (con un paso de generación de imágenes)

Esto es especialmente útil porque te saca tiempo muerto. El objetivo no es “que sea perfecto”. Es que esté lo suficientemente bien como para publicar y luego mejorar con iteraciones.

Y en el proyecto se enfatiza que la herramienta usa el contexto del video: transcripción, audio y la estructura general del contenido.

🧠 Voz clonada y generación desde texto: flujos con Gemini, Qwen TTS y modelos de audio

La parte de creación desde texto incluye otro bloque potente: voz clonada.

El flujo que describe el proyecto tiene dos elementos:

- Clonación de voz usando una referencia de audio

- Generación de contenido a partir de texto, para construir el video completo

Se menciona explícitamente que con la integración se puede:

- Subir audio de referencia

- Clonar la voz del creador

- Generar videos con voz clonada o incluso con audio de terceros

Para el componente de clonación se habla de un modelo de audio accesible de forma gratuita (y también de que puede instalarse en servidor, aunque el proyecto lo usa desde Hugging Face). También se menciona que se utiliza PlayGrade para capturar “screenshots” vinculados al modelo de voz, y se usa Rimmaut**ion** (así aparece mencionado) como parte del soporte para subtítulos.

Además, la app maneja:

- Voces clonadas con Qwen

- Videos con opciones de subtítulos y efectos

Si tu objetivo es escalar contenido, este tipo de pipeline es lo que convierte un “workflow manual” en un sistema repetible.

🧱 Arquitectura por dentro: front-end, back-end y orquestación

Algo que me gustó del planteamiento es que no se queda en “la IA hace todo”. El proyecto reconoce que necesitas infraestructura.

Según lo que se describe, existe un frontend y un backend personalizado para procesar videos, con gestión de integraciones y pipelines. También se menciona que parte del sistema se apoya en:

- Integraciones con APIs

- Procesos de obtención de frames o screenshots

- Subtitulado y transcripción

- Generación de imágenes para miniaturas

En proyectos así, el “valor” no es solo el modelo. Es la orquestación y cómo encapsulas el flujo para que sea usable como producto.

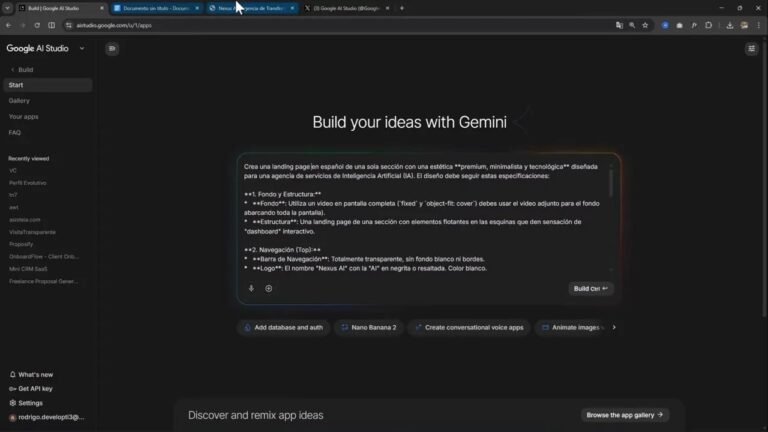

🖼️ Miniaturas con IA: de screenshots a propuestas conceptuales

Al inicio, el sistema tenía una funcionalidad de miniaturas basada en obtener screenshots del video. Eso sirve, pero no siempre conecta con el mensaje exacto.

Lo que se intentó construir en la app fue mejorar este enfoque: mantener el botón de “captura” existente, pero agregar una opción para generar miniaturas conceptuales.

En el proyecto se describe un flujo que hace esto:

- Generar tres propuestas escritas para miniaturas

- Si una propuesta gusta, al apretar un botón se genera la imagen con Nano Banana 2

Esta parte fue la más “caótica” por razones técnicas, especialmente por errores de API y temas de modelos.

✅ Error 404, error 500 y aprendizaje operativo

Durante la validación aparecieron problemas como:

- Un error al generar propuesta de miniatura (se menciona un 404)

- Errores internos de generación de imagen (por ejemplo 500)

- Problemas por reiniciar backend

- Cambios inesperados de modelo por compatibilidad o existencia

Lo que rescato no es el error en sí, sino la mentalidad: cuando integras, inevitablemente vas a tener “bordes rotos”. La clave es instrumentar DevTools, copiar consola, volver a probar y ajustar.

📍 Persistencia: títulos, descripciones y miniaturas no deberían “desaparecer”

Uno de los hallazgos más claros fue que algunas salidas del sistema no persistían bien en la interfaz. Por ejemplo, al generar sugerencias del kit de publicación, si sales y vuelves, se perdía el resultado.

En una app real, eso no es tolerable porque destruye la iteración humana. Si el usuario debe volver a generar cada vez, pierdes tiempo y aumentas el costo.

La solución que se plantea es:

- Que el sistema guarde el título y descripción generados

- Que no se borren hasta que el usuario haga clic en “regenerar”

- Que lo mismo aplique para propuestas de miniaturas

Este aprendizaje es oro si estás construyendo tu propia app: la persistencia del estado es parte de la experiencia de usuario, no es un “detalle técnico”.

🎯 Miniatura como conjunto: enlace entre título, descripción y imagen

La miniatura no puede vivir sola. Tiene que trabajar en conjunto con lo que dices (título y descripción) y con lo que enseñas (el video).

En el proyecto se nota que, aunque se generó una miniatura que era “buena” estéticamente, no necesariamente estaba alineada con el contexto del tutorial o el tema específico del contenido.

La conclusión que se alcanza es muy concreta: la miniatura debería basarse explícitamente en el título y la descripción. No basta con el video como fuente, o con un prompt genérico.

Por eso la dirección de mejora es rediseñar el motor para enlazar:

- Enlace (si aplica al contexto o referencia)

- Título

- Miniatura (propuesta y generación)

Y alimentar el prompt de la imagen con el título sugerido para que la composición visual refuerce el mensaje.

🧩 Ojo con los prompts rígidos: contexto dinámico por tipo de video

Hubo una propuesta en el proyecto para que, al generar miniaturas para un tipo de contenido educativo o tecnológico, se use una estética fija (como “software SaaS tutorial” o “coding app development showcase”).

Y aquí entra una crítica importante, porque el objetivo es que la herramienta sea amplia. Si hardcodeas una estética para “todo”, la herramienta se vuelve útil solo para un nicho.

La corrección que se menciona es clara: debe entender el contexto dependiendo del video, y no asumir que todos son del mismo estilo.

En otras palabras, no queremos que el modelo “encaje” el video en un molde. Queremos que el sistema elija un enfoque visual coherente con el contenido específico.

📱 Lo que más importa para escalar: eficiencia, costos y control

Este proyecto muestra algo que se repite en todos los sistemas de video con IA:

- Eficiencia: no puedes procesar 2 horas de video con visión completa

- Economía: shorts y flujos livianos bajan el costo de iteración

- Control: human in the loop evita destruir el sentido

- Persistencia: si el usuario pierde trabajo, baja la adopción

- Orquestación: la magia real está en unir herramientas (Gemini, Whisper, Qwen, Nano Banana 2, etc.)

Si lo piensas bien, lo que se construye es un “mini estudio de producción” que opera con IA pero conserva el criterio humano donde es necesario.

🔗 Links importantes (comunidad y recursos)

Parte de este ecosistema se conecta con una comunidad donde comparte recursos para construir apps con IA, prompts y herramientas exclusivas.

- Comunidad (Skool): https://www.skool.com/vibe-coding-crea-apps-con-ia-5930

- Hosting recomendado con cupón: https://hostinger.com/rodrigo

Además, existe una playlist del creador con maratones sobre cómo construir apps con IA:

📌 Qué haría después (y por qué): mejoras de persistencia, thumbnails inteligentes y robustez

Al cierre del proyecto, las mejoras que se dejan planteadas están alineadas con los aprendizajes que aparecieron durante la prueba:

- Persistencia del kit de publicación (título y descripción)

- Persistencia de propuestas de miniaturas

- Contexto inteligente para miniaturas: enlazar título y descripción

- Prompt dinámico: estética coherente según el tipo de video, no fija para todo

- Robustez contra errores: reinicios de backend, manejo de modelos y logging

Este es el tipo de evolución que hace que una app deje de ser “demo” y pase a ser una herramienta que la gente usa para producir contenido de forma consistente.

✅ Ideas aplicables si estás construyendo tu propia app de video con IA

Si estás en una etapa temprana y te quieres ahorrar dolores, estas ideas derivadas del proyecto te pueden servir:

- Separa flujos: edición (audio y video) y creación desde texto, con pipelines distintos.

- Define reglas de edición (silencios, duración mínima, agresividad por plataforma).

- Usa Whisper para tiempos cuando el video es largo o cuando necesitas precisión de segmentación.

- Agrega Human in the loop y botones de revertir cortes o corregir segmentos.

- Guarda resultados: título, descripción y propuestas de miniaturas no deberían ser temporales.

- Genera miniaturas en conjunto con texto, no solo desde el frame del video.

- Instrumenta errores: DevTools, logs, y vuelve a probar con configuraciones conocidas.

🚀 Conclusión: IA para producir contenido, pero con un sistema que respete el criterio humano

La conclusión que me deja este episodio es bastante clara: sí, los modelos de IA hacen mucho. Pero el trabajo real es construir un sistema que conecte todo en un flujo usable, eficiente y con control.

Cuando la app puede transcribir, detectar cortes, editar con criterios, clonar voz, generar elementos visuales, proponer un kit de publicación y hasta crear miniaturas, lo que obtienes es un “motor” de producción.

Y si ese motor respeta la persistencia del estado, permite revertir errores y adapta prompts al contexto del contenido, entonces deja de ser una demo y se convierte en una herramienta que puede sostener una rutina de publicación.

Si te interesa la idea de construir herramientas como esta (vibe coding, prompts, integraciones), en la comunidad comparto recursos y sigo actualizando el camino. Y si estás construyendo tu propia app de IA, ojalá esto te sirva como mapa para priorizar lo importante: control humano, persistencia y contexto real.