Kimi K2.6 acaba de salir y venía con una promesa interesante: codificación de vanguardia, ejecución a largo plazo y capacidades de enjambre de agentes. Eso, por supuesto, suena muy bien en marketing. La pregunta real es otra: ¿rinde de verdad cuando lo pones a trabajar creando una aplicación web?

Eso fue exactamente lo que quise probar. No con un benchmark bonito, no con una tabla comparativa aislada, sino con algo que para mí pesa más: pedirle que genere un dashboard en React con un solo prompt y ver si entrega un resultado serio, usable y cercano a lo que hoy ofrecen modelos como Claude Opus o GPT.

La razón por la que esta prueba me parece relevante es simple. Hoy mucha gente está buscando alternativas para programar con IA sin reventar el presupuesto. En ese contexto, un modelo que funcione bien y además sea más barato puede convertirse en una herramienta muy atractiva para crear apps, prototipos, interfaces y flujos completos de desarrollo.

Si quieres revisar el modelo directamente, aquí están sus puntos de acceso oficiales:

Y si quieres tener el contexto completo de la prueba original, aquí tienes el video:

Tabla de contenido

- 🧠 Qué promete Kimi K2.6 y por qué llamó mi atención

- ⚙️ El contexto real: crear un dashboard React con un solo prompt

- 🌐 Probando Kimi desde su web: opciones interesantes más allá de chat

- 💻 Plan B: usar Kimi K2.6 desde VS Code con Kilo Code y OpenRouter

- 🧪 Lo que realmente importa: cómo se comportó el modelo al programar

- 💸 Precio y eficiencia: uno de los puntos más fuertes de Kimi

- 🛠️ El resultado final del dashboard: qué hizo bien Kimi K2.6

- 📊 ¿Está al nivel de Claude Opus, Sonnet o GPT?

- 🇨🇳 Modelos chinos para programar: Kimi me gustó, pero también hay otro que sigo usando

- 🧭 Cuándo usaría Kimi K2.6 y cuándo me fijaría en otra opción

- 🚀 Si estás construyendo apps con IA, esto es lo que rescataría de la prueba

- ✅ Conclusión: Kimi K2.6 sí merece atención seria

🧠 Qué promete Kimi K2.6 y por qué llamó mi atención

Kimi K2.6 no llegó como una actualización más. Lo interesante es que se posiciona como un modelo fuerte para desarrollo, con énfasis en tres cosas que importan bastante cuando uno construye software con IA:

Capacidad de programación avanzada

Ejecución sostenida en tareas largas

Comportamiento agéntico, incluyendo división de tareas entre agentes

Eso último no es menor. Muchos modelos escriben código aceptable cuando la tarea es corta, pero se empiezan a perder apenas hay que iterar, compilar, revisar errores, corregir estructura y seguir una secuencia lógica sin desviarse. Ahí es donde se nota si el modelo realmente “piensa” el flujo de trabajo o si solo improvisa tokens con buena pinta.

Ya había probado Kimi antes, en una versión anterior, y me había dejado una impresión positiva. En una prueba previa me generó el diseño de una tienda de audio con una sola pasada y un solo prompt. Eso me llamó la atención porque no todos los modelos logran una salida visual convincente con una instrucción simple. A veces hay que ajustar varias veces, reescribir medio brief, corregir layout, volver a pedir componentes y recién ahí empieza a tomar forma.

Con ese antecedente, tenía sentido probar esta nueva versión en algo más concreto.

⚙️ El contexto real: crear un dashboard React con un solo prompt

Para evaluar un modelo de este tipo, prefiero una prueba práctica y simple. Nada de prompts rebuscados para hacerlo lucir. La idea fue pedirle un dashboard en React, usando un prompt corto y directo, y ver cómo resolvía estructura, datos demo, componentes e interacciones básicas.

Ese tipo de tarea es buena para medir varias cosas al mismo tiempo:

Si entiende bien una solicitud de producto o interfaz

Si organiza correctamente una app web moderna

Si entrega un resultado visual coherente

Si añade elementos que normalmente se esperan en un dashboard

Si compila y corre sin convertir la experiencia en un festival de errores

Además, era una buena forma de compararlo, al menos de manera práctica, con modelos que hoy se usan mucho para programación: Claude Sonnet, Claude Opus y GPT. No necesariamente para decir “este destruye al otro”, porque esas comparaciones absolutas casi nunca son honestas, sino para responder algo más útil: ¿se queda atrás o está en el mismo nivel para este caso de uso?

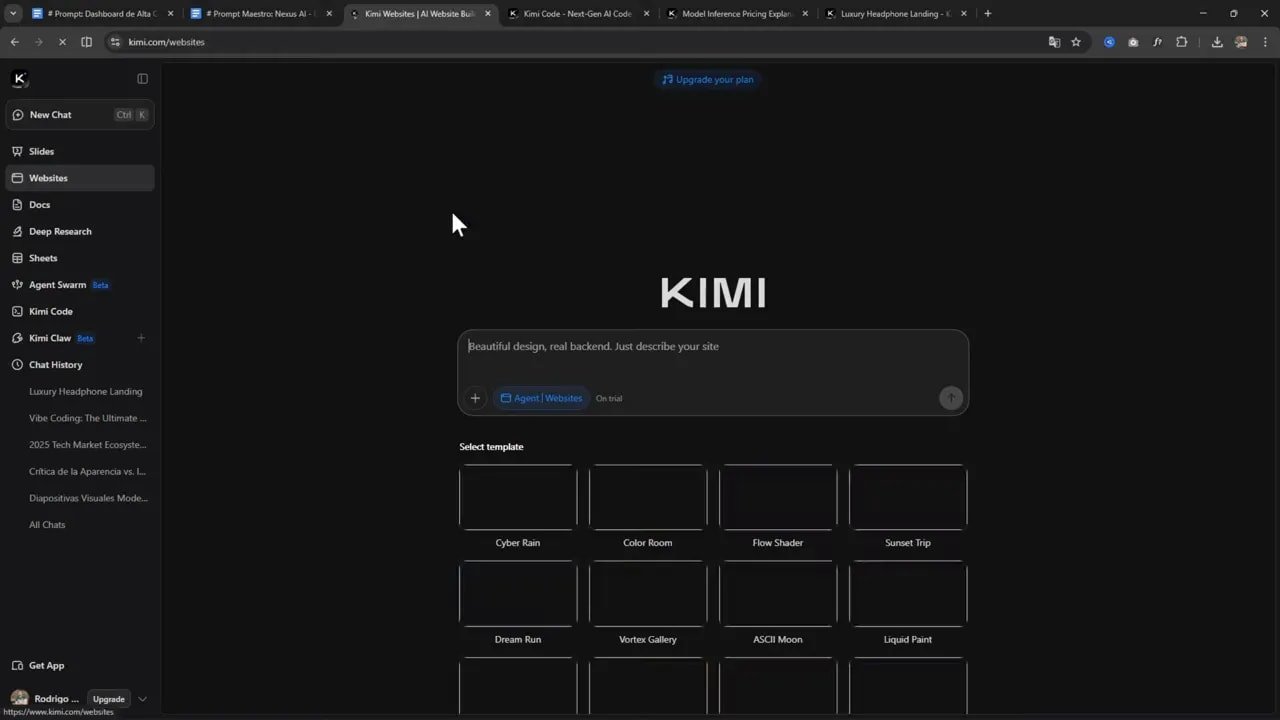

🌐 Probando Kimi desde su web: opciones interesantes más allá de chat

La primera idea fue usar Kimi directamente desde su sitio web, que ya ofrece bastante más que una caja de texto.

Dentro del ecosistema de Kimi se puede acceder a:

La aplicación web en Kimi.com

La API

Kimi Code, orientado a programación

Generación de websites

Slides

Documentos

Deep Research

Planillas

Agent Swarm, para dividir tareas complejas entre múltiples agentes

Eso ya da una señal importante. Kimi no se está presentando solo como “otro LLM”, sino como una plataforma con herramientas concretas para producir cosas. En particular, me pareció interesante la parte de websites y la de slides, porque generan activos que suelen ser útiles en trabajo real: demos, presentaciones, landing pages y prototipos.

La idea inicial fue usar el agente de websites y pegar ahí el prompt del dashboard. Todo iba bien hasta que apareció el clásico problema de lanzamiento exitoso: había mucha gente usándolo al mismo tiempo.

Cuando eso pasa, hay dos opciones. Esperar o improvisar. Y como la idea era probar el modelo sí o sí, tocó improvisar.

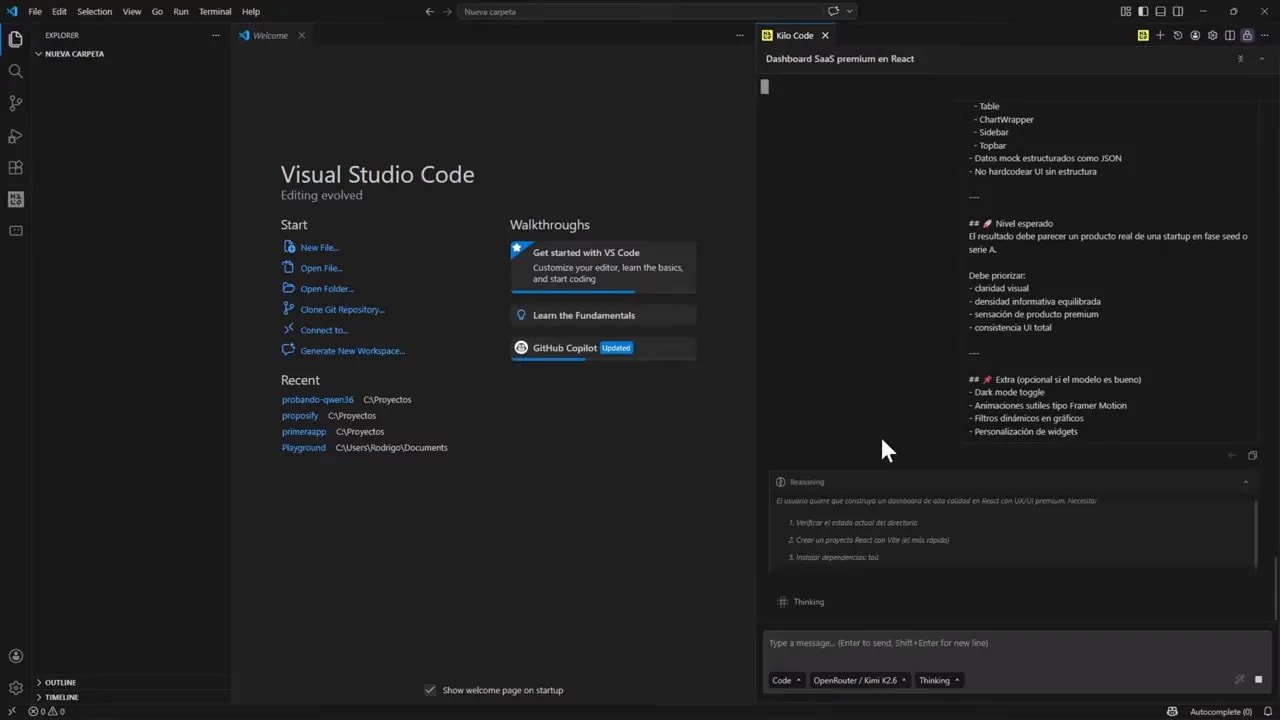

💻 Plan B: usar Kimi K2.6 desde VS Code con Kilo Code y OpenRouter

Como el acceso web estaba congestionado, me fui directamente a VS Code para usar el modelo desde un entorno más práctico para desarrollo. Ahí ya tenía instalado Kilo Code, que permite conectar modelos y trabajar con flujos de coding asistido dentro del editor.

Si quieres montar algo parecido, el punto clave es este: no hace falta complicarse demasiado. La configuración fue bastante simple.

El flujo quedó así:

Abrir VS Code

Usar Kilo Code como interfaz de trabajo

Conectar OpenRouter como proveedor

Seleccionar Kimi K2.6 desde los modelos disponibles

Pegar el prompt y ejecutar

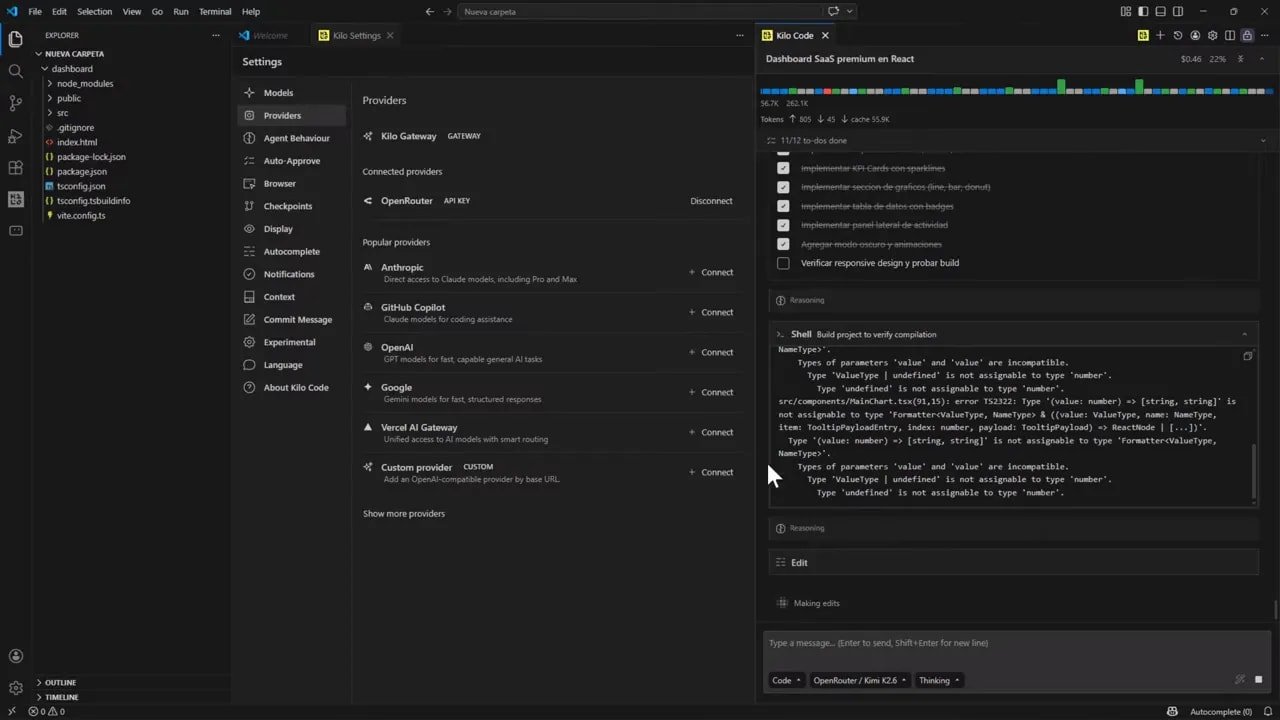

La primera opción directa no funcionó porque pedía créditos. Entonces cambié a la versión disponible vía OpenRouter, que ya tenía configurada. Ahí sí funcionó de inmediato.

La configuración en Kilo Code fue básicamente esta:

Entrar a Providers dentro de los settings

Agregar una API Key de OpenRouter

Cargar algo de crédito

Elegir el modelo deseado

Listo. Nada dramático. Una vez hecho eso, puedes usar prácticamente cualquier modelo que OpenRouter tenga disponible dentro de ese flujo.

Para quien quiera replicar este setup, estos enlaces son los relevantes:

🧪 Lo que realmente importa: cómo se comportó el modelo al programar

Acá viene la parte que de verdad interesa.

Una vez enviado el prompt, Kimi K2.6 empezó a trabajar de manera bastante fluida. Y eso se nota rápido cuando conoces cómo actúan los modelos menos capaces. Los modelos flojos suelen mostrar ciertas señales muy claras:

Se pierden entre pasos

Intentan ejecutar comandos sin sentido

Rompen el flujo de build

No verifican responsive

Crean estructura inconsistente

Terminan entregando algo a medio cocinar

Acá no pasó eso.

Lo que se vio fue un comportamiento bastante ordenado. El modelo fue revisando pasos, verificando el diseño responsive y compilando el proyecto. Es decir, no solo generó código. También mostró señales de estar siguiendo una secuencia lógica de resolución.

Eso, para mí, es una de las mejores señales de que un modelo tiene una capacidad agéntica decente. No se trata únicamente de que “escriba React”, sino de que sea capaz de:

entender la tarea,

organizar el trabajo,

avanzar sin desviarse,

validar partes del proceso,

llegar a una salida lista para ejecutarse.

Y en esta prueba, Kimi K2.6 se vio sólido en ese punto.

Señales concretas que dejaron buena impresión

No se perdió durante la ejecución

Revisó aspectos de diseño responsive

Compiló el build

Mantuvo una progresión fluida

No dio la sensación de improvisar a ciegas

Esto puede sonar básico, pero quienes trabajan a diario con modelos para código saben que no lo es. Hay sistemas muy buenos en benchmark que luego, en la práctica, desperdician tiempo y tokens en decisiones erráticas.

💸 Precio y eficiencia: uno de los puntos más fuertes de Kimi

Acá aparece uno de los argumentos más interesantes de Kimi K2.6: el costo.

En esta prueba, generar el proyecto costó menos de medio dólar y ya estaba prácticamente terminado. Eso, si el resultado es bueno, es muy competitivo.

Y ese es precisamente el punto. Nadie discute que modelos premium como Claude Opus pueden entregar resultados excelentes. El problema es que muchas veces el costo se vuelve pesado cuando trabajas de forma continua, iteras mucho o quieres construir más de una app.

Entonces la conversación deja de ser “¿cuál es el mejor modelo absoluto?” y pasa a ser “¿cuál me entrega una calidad suficientemente alta al mejor costo posible?”.

En ese sentido, Kimi K2.6 se ve atractivo porque:

ofrece buen rendimiento en tareas de programación,

muestra comportamiento agéntico razonable,

y su costo es significativamente menor que alternativas más caras.

Si trabajas creando interfaces, MVPs o apps internas, esa diferencia de precio puede acumularse rápido. Y cuando alguien ya está cansado de los límites o los costos de herramientas como Claude Code, encontrar una alternativa funcional se vuelve bastante relevante.

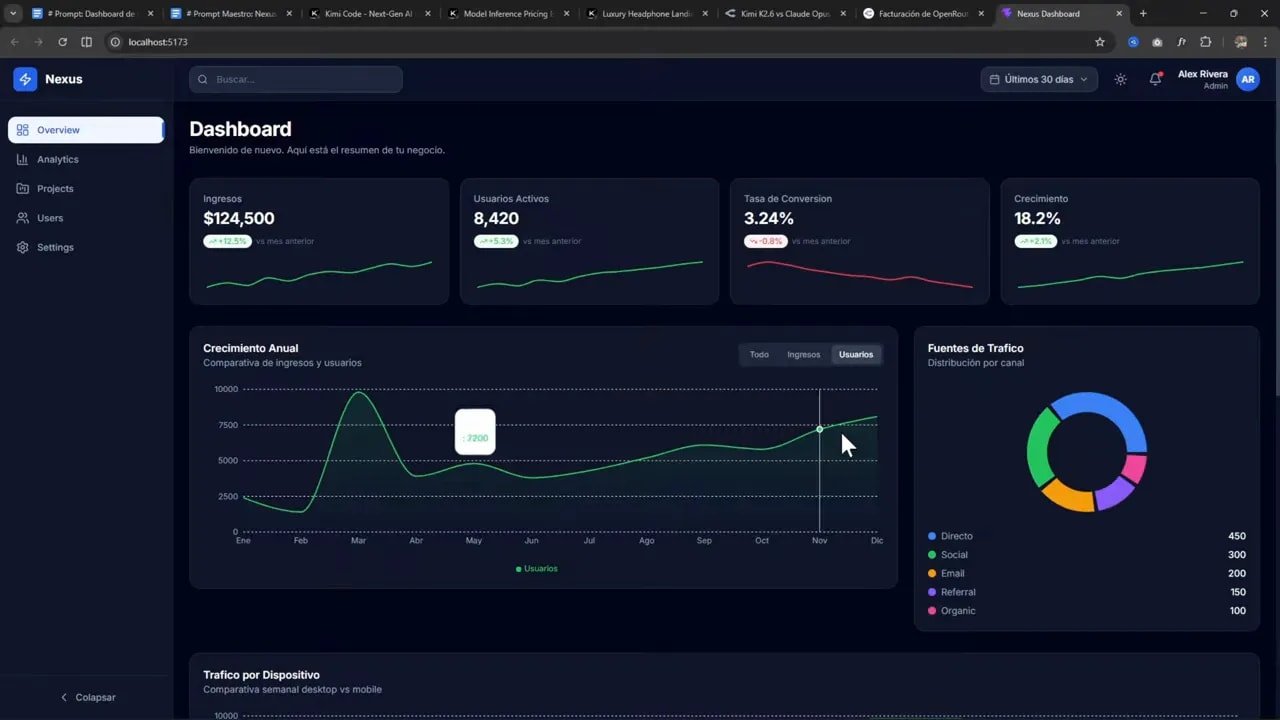

🛠️ El resultado final del dashboard: qué hizo bien Kimi K2.6

Una vez que el proyecto estuvo listo, quedaba lo más importante: abrirlo y ver si realmente había cumplido con lo pedido.

Para levantar el servidor, incluso le pedí al agente que lo hiciera. Sí, se puede hacer manualmente en terminal sin gastar extra. Pero también quise medir esa comodidad adicional, porque mucha gente justamente busca automatizar al máximo estas pequeñas tareas.

Y al revisar el dashboard, la impresión fue positiva.

La aplicación cargó con bastante información demo, tenía secciones esperables y elementos de interfaz que se alineaban con el tipo de dashboard solicitado. Entre lo que destacó:

Registros o actividad reciente

Notificaciones

Estructura general coherente

Interacciones que funcionaban a la primera

Esto último importa mucho. Hay modelos que generan algo que se ve bonito en captura, pero al interactuar con la UI empiezan las fallas. Botones que no hacen nada, paneles inconsistentes, navegación rota o componentes sin lógica mínima.

Acá varias de esas cosas funcionaron bien desde el primer intento. Y sinceramente, eso no siempre pasa.

La sensación general fue que el modelo cumplió. No dio la impresión de estar por debajo de lo que hoy ofrecen otros modelos fuertes del mercado para este tipo de tarea puntual.

📊 ¿Está al nivel de Claude Opus, Sonnet o GPT?

La comparación justa acá no debería ser un titular exagerado del estilo “destruye a X”. Lo más honesto es decir esto: para esta prueba concreta, no sentí que Kimi K2.6 se quedara atrás.

Comparándolo con resultados recientes que he visto en modelos como:

Claude Sonnet

Claude Opus

GPT

el nivel percibido fue bastante similar en cuanto a la calidad del resultado final. El dashboard quedó bien, la ejecución fue fluida y el costo fue bajo. Esa combinación ya es suficiente para tomárselo en serio.

Ahora bien, eso no significa automáticamente que sea “mejor” en todos los escenarios. Esa palabra casi siempre depende del caso de uso. Un modelo puede destacar más en planificación, otro en debugging profundo, otro en contexto largo, otro en frontend visual. Pero si la pregunta es si Kimi K2.6 merece estar en la conversación junto a los modelos grandes, mi impresión es que sí.

Especialmente si lo que te interesa es:

crear apps con IA,

hacer prototipos rápidos,

generar dashboards o interfaces,

trabajar desde VS Code con un flujo asistido,

o mantener el costo bajo control.

🇨🇳 Modelos chinos para programar: Kimi me gustó, pero también hay otro que sigo usando

Hay un dato interesante en todo esto. Kimi es un modelo de origen chino, y dentro de ese grupo me parece una opción bastante decente. Sin embargo, no es el único que vale la pena mirar.

De hecho, hay otro modelo chino que personalmente me gusta mucho: Minimax.

Y acá voy a ser bien directo. Aunque se habla bastante más de Kimi, Minimax me ha parecido extremadamente consistente en uso real. En mi experiencia, me ha funcionado bien de forma sostenida, y además tiene una ventaja importante: es más barato.

Eso sí, también tiene sus limitaciones. No todo es precio.

Donde Minimax gana

Input y output más baratos que Kimi

Buena consistencia práctica

Donde Kimi mantiene ventaja

Soporte para entrada por imagen

Más útil si trabajas con referencias visuales o screenshots

Mayor flexibilidad para flujos donde muestras errores mediante capturas

Eso último es clave. Si tu flujo de trabajo incluye pasarle al modelo una captura de pantalla con un error, una referencia visual de diseño o una UI que quieres replicar, que el modelo acepte imágenes deja de ser un detalle y se transforma en una función central.

También hay diferencias en capacidad máxima de tokens, pero siendo muy honesto, en la práctica lo que más pesa es otra cosa: si el modelo te resuelve bien el trabajo que le das.

Y tanto Kimi como Minimax entran hoy en esa conversación para quien quiere programar con IA sin irse siempre a las opciones más caras del mercado.

🧭 Cuándo usaría Kimi K2.6 y cuándo me fijaría en otra opción

Después de esta prueba, mi lectura es bastante clara.

Usaría Kimi K2.6 si lo que necesito es:

crear una app o dashboard rápido,

trabajar con generación de frontend en React,

probar ideas con un solo prompt,

usar un modelo con señales razonables de comportamiento agéntico,

mantener costos bajos frente a opciones premium,

o apoyarme en imágenes de referencia o screenshots.

Miraría otras alternativas si mi criterio principal fuera otro, por ejemplo:

buscar el máximo rendimiento posible sin importar precio,

tener una preferencia fuerte por otro ecosistema o proveedor,

o elegir el modelo más barato disponible si no necesito input visual.

La ventaja de este momento del mercado es justamente esa: ya no hay una sola opción dominante para todo. Hay varios modelos muy capaces y la decisión depende cada vez más de tu flujo real de trabajo.

🚀 Si estás construyendo apps con IA, esto es lo que rescataría de la prueba

Más allá del modelo puntual, creo que esta prueba deja varias ideas útiles para cualquiera que esté creando aplicaciones con IA:

La prueba real vale más que el benchmark

Las tablas sirven, pero construir una app concreta revela mucho más.El costo importa

No sirve de mucho un modelo brillante si cada iteración se vuelve demasiado cara.La fluidez del agente cambia toda la experiencia

Cuando el modelo sigue pasos lógicos, compila y verifica, el trabajo se siente muy distinto.Un buen prompt simple sigue siendo una gran prueba

Si el modelo necesita veinte correcciones para levantar una interfaz decente, algo falla.La entrada visual puede ser decisiva

Poder usar imágenes o screenshots es tremendamente útil en desarrollo moderno.

Si estás explorando este mundo de vibe coding, creación de MVPs, SaaS asistidos por IA o desarrollo rápido de productos, te recomiendo revisar también estos recursos:

Comunidad en Skool para acceder a herramientas, prompts y recursos para crear apps con IA

PrimeraApp.com, herramienta exclusiva para miembros orientada a ayudarte a generar el prompt ideal para comenzar tu aplicación

✅ Conclusión: Kimi K2.6 sí merece atención seria

Mi conclusión es bastante simple: Kimi K2.6 me dejó una muy buena impresión.

No solo porque sacó un dashboard convincente con un solo prompt, sino porque lo hizo con una ejecución fluida, una estructura razonable y un costo que se siente competitivo. En un mercado donde cada vez más personas buscan crear apps web con IA sin gastar una fortuna, eso pesa mucho.

¿Es automáticamente mejor que Claude Opus 4.7 en todo? No me parece serio afirmar algo tan absoluto con una sola prueba. Pero sí puedo decir algo que para fines prácticos importa bastante: no se sintió por detrás en este caso real.

Y eso ya lo pone en una categoría muy interesante.

Si estás buscando un modelo para programación, dashboards en React, generación de apps o flujos de desarrollo asistido desde VS Code, Kimi K2.6 definitivamente vale la pena probarlo. Sobre todo si además te importa optimizar presupuesto.

En resumen:

Buen rendimiento práctico

Resultado visual sólido

Comportamiento agéntico prometedor

Costo atractivo

Competitivo frente a modelos mucho más caros

Y si después quieres que revise también Minimax 2.0 o compararlo más a fondo con otros modelos para crear apps completas, esa también sería una comparación muy interesante.